Az izraeli-amerikai-iráni háború lett a világtörténelem első olyan háborúja, melyben totális szerepet kap a mesterséges intelligencia. A háború szellemiségének végleges dehumanizálása mellett mit jelent ez?

Kövesd Telegram csatornánkat!

Folyamatosan frissítve a háborús hírekkel és a nagyvilág történéseivel

Mesterséges intelligencia a hadviselésben

Az MI-vezérlés technológiai koncepcióból mára standard katonai gyakorlattá vált. A célkijelölés sebessége nagyságrendekkel megnőtt, miközben a rendszer „látása” is jelentősen elmélyült: nemcsak a nyilvánvaló objektumokat azonosítja, hanem a logisztikai, kommunikációs és energetikai rendszereket is feltérképezi. Így az ellenség egyfajta „hálózati portréja” jön létre – olyan átfogó kép, amelyet pusztán emberi erőforrásokkal gyakorlatilag lehetetlen lenne megalkotni.

A mesterséges intelligenciával működő eszközök, eljárásrendek annyira nem számítanak újdonságnak, hogy mondhatjuk, a főpróbájuk már Gázában megtörtént, amikor Izrael csupán arra hagyatkozva jelölte ki célpontjait. Erről egy cikksorozatban számoltunk be, az ezen cikkünkben is megjelenő Lavender kapcsán. Ez az MI-modell a totális digitális megfigyelést tette lehetővé telefonok, közösségi oldalak, helymeghatározás, kapcsolatok elemzésének, figyelésének alapján, majd minden gázai lakost 1-100-ig pontozott, hogy megjelöljék a „potenciális militáns”, azaz Hamász vagy a Palesztin Iszlám Dzsihád tagjaként az embereket.

Az amerikai és az izraeli hadsereg legújabb mesterséges intelligencia eszközeit használja az Irán elleni támadásokhoz is. Ennek keretében például 2026. február 28-án, az „Epic Fury” művelet első napján az amerikai hadsereg gépei elvégezték azt a munkát, ami korábban hetekig tartó stábmunkát igényelt: 24 óra alatt azonosítottak, rangsoroltak és megsemmisítésre jelöltek ki mintegy 1000 célpontot Irán területén.

Ezt az eredményt a hagyományos értelemben vett hírszerzés eszközeivel nem lehet elérni, hanem két technológia – a Palantir Maven Smart System és az Anthropic cég Claude nyelvi modelljeinek – kombinációja tette lehetővé.

A Claude rendszert „széles körben vetették be” hadműveleti tervezésre, célpont-azonosításra, hírszerzési értékelésekre, harci szimulációkra és logisztikára – annak ellenére, hogy Trump az Anthropic vállalattal folytatott „etikai” vitája közepette elrendelte, hogy ne használják. A Claude egyébként egy nagy nyelvi modell, amely egy zárt katonai körbe van integrálva. Kész célcsomagokat állít össze: koordináták, fegyverkezési ajánlások és még automatizált jogi indoklások is minden egyes csapáshoz, a háborús törvények betartása érdekében. A technológia „lerövidíti a megsemmisítési láncot” (kill chain) – vagyis azt a folyamatot, amely a célpont azonosításától a jogi jóváhagyáson át egészen a csapás elindításáig tart. A láncolatnak a végén áll egy tiszt, ugyanakkor neki csak ellenőrző funkciót kell ellátnia.

A másik rendszer, amit használnak, a Maven. Ez az Amerikai Védelmi Minisztérium gépi tanuláson alapuló célazonosító és hadműveleti tervező eszköze, amely segít automatizálni a „kill chain” (megsemmisítési lánc) folyamatát. A rendszert a Palantir, az Amazon Web Services, a Microsoft, a Maxar és számos más technológiai és védelmi vállalat hozta létre. Főpróbája az ukrán fronton volt. Orosz technika, aknák, hadoszlopok drónokkal és kereskedelmi műholdakkal történő észlelésére alkalmazták; tüzérségi rendszerek és HIMARS-ok számára valós idejű koordináták biztosításával a támadások előtt és után. A támadások hatékonyságának értékelésével még jobban növelték a hatásfokot, ugyanis minden lövés után a rendszer összevetette az „előtte” és „utána” képeket, és jelentést készített a találatról.

Izrael MI rendszerei, mint a Habsora és a Lavender, célkijelölésre és a csapások „értékének” autonóm meghatározására szolgálnak – beleértve olyan számításokat is, amelyek szerint több tucat vagy akár több száz civil áldozat „elfogadható” lehet egyetlen „fenyegető entitás” kiiktatásáért.

Úgy tűnik, Irán tisztában van az MI jelentette veszéllyel, ezért támadásokat hajtott végre az Amazon egyesült arab emírségek-beli és bahreini adatközpontjai ellen, amelyek leállították a regionális felhőszolgáltatásokat. Hogy még jobban meggyengítsék a cionista tengely MI képességeit, más létesítmények, például a Microsoft egyesült arab emírségek-beli adatközpontja lehet a következő célpont.

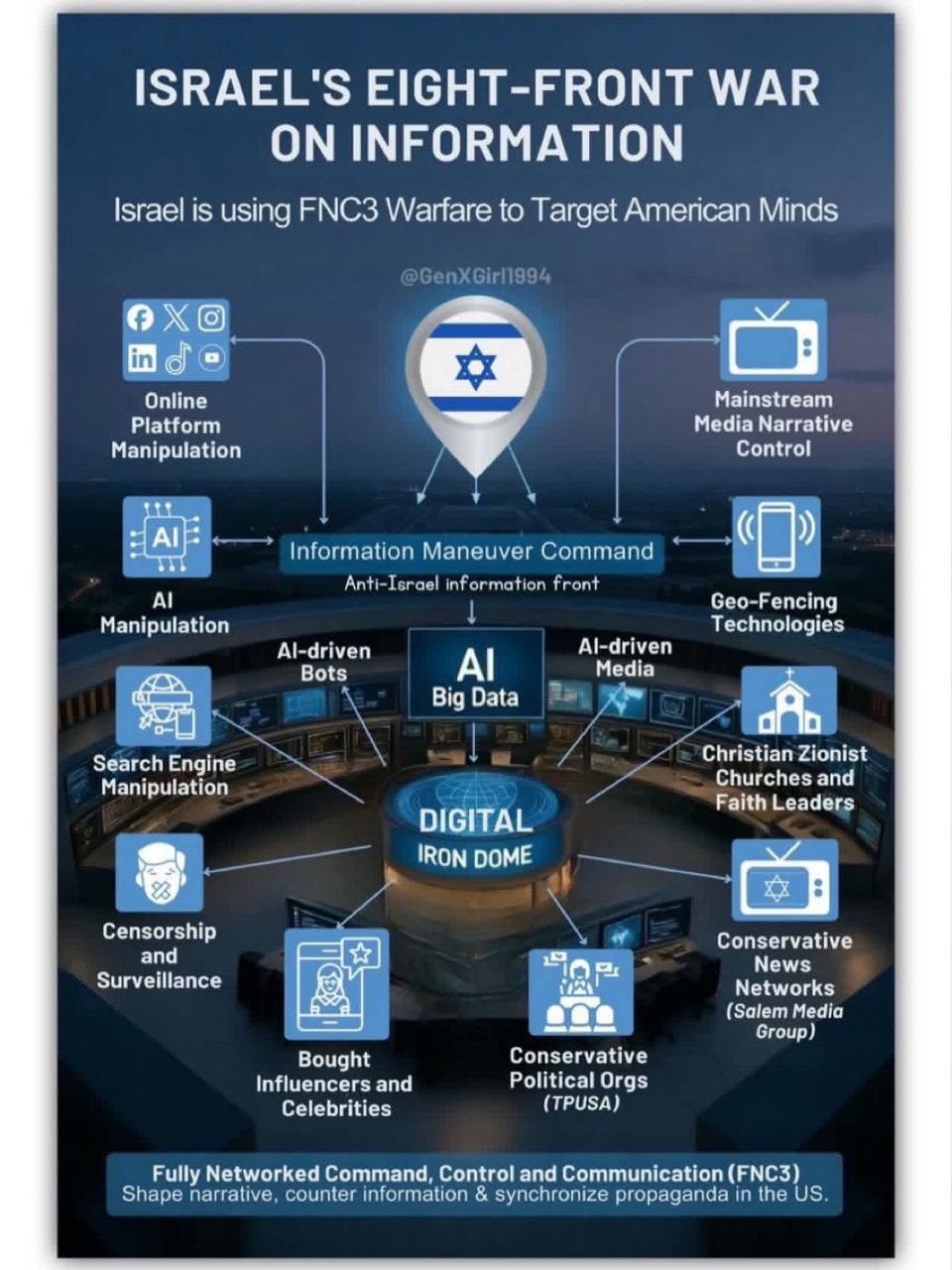

Digitális vaskupola

A háború teljes egészében kiterjed a digitális térbe is. Izrael egy „többfrontos információs háborút” folytat – ezt nevezhetjük digitális vaskupolának – amelynek célja az amerikai közvélemény befolyásolása. A cionisták az úgynevezett FNC3 (Fully Networked Command, Control and Communication) rendszer segítségével koordinálják az információs műveleteket.

A rendszer mesterséges intelligenciára és nagy adathalmazokra (AI Big Data) épül, és így alkotja meg a cionista érdek kiszolgálására szolgáló rendszert.

A befolyásolás több csatornán keresztül történik: online platformok (közösségi média) manipulálásával, mesterséges intelligencia használatával, keresőmotorok befolyásolásával, valamint cenzúra és megfigyelés alkalmazásával.

A rendszernek részei az AI-vezérelt botok és az AI-alapú médiatartalom használata is.

A narratíva terjesztésében szerepet játszanak megvásárolt influenszerek és hírességek, konzervatív politikai szervezetek, hagyományos médiacsatornák (újságok, híradó, televízió), valamint az álkeresztény (többségében neoprotestáns) cionista egyházak és vallási vezetők.

A földrajzi alapú digitális korlátozásokat (geo-fencing technológiákat) és a fősodratú média narratívájának ellenőrzését is alkalmazzák.

Az FNC3 rendszer célja a narratívák formálása, a judeokrata világrenddel szembehelyezkedő információk kezelése és a cionista propaganda összehangolása az Egyesült Államokban, de lényegében világszerte.

A Pentagon mesterséges intelligenciával keresi a gyenge pontokat a Kína elleni jövőbeli konfliktusban

A Pentagon mesterséges intelligenciát alkalmaz annak feltérképezésére is, hogy hol találhatók gyenge pontok a kínai infrastruktúrában, például az elektromos hálózatokban vagy a védett kommunikációs rendszerekben. A projektet a lehetséges katonai konfliktusokra való felkészülés részeként indították el – írja a Financial Times.

Miért veszélyes a mesterséges intelligencia katonai alkalmazása?

A mesterséges intelligencia alkalmazása alapvetően felgyorsítja a tervezést anélkül, hogy idő maradna a valódi elemzésre, ahol az emberi tényező is kiteljesedhet, így a hadjárat gyors, ipari léptékű gyilkolássá válhat.

A hivatalosan „ember a rendszerben” elv ellenére a kezelők a gyakorlatban az MI által javasolt célpontokra támaszkodnak, ami növeli a civil „járulékos veszteségek” kockázatát – különösen, ha a rendszereket eleve megengedő civil-katonai arányokkal programozták, mint Izrael esetében, ahol láthattuk, hogy akár több száz áldozat is belefér; kisgyermekek is, mint például Hamenei unokája.

Az is súlyos aggályokat vet fel, hogy az MI-algoritmusok átláthatatlansága miatt a parancsnokok valójában nem értik, hogyan működnek a számítógépes hírszerzési és célkijelölő rendszereik.

Ráadásként a hadi alkalmazás során a technológiai vállalatok „értékes kiképzési adatokat” szereznek, amelyeket később belföldön is felhasználhatnak rendfenntartásra, zavargások kezelésére vagy akár belső felkelések elleni műveletekre.

Egy King’s College-tanulmány, amelyet az iráni háború előestéjén tettek közzé, kimutatta, hogy a hadijáték-forgatókönyvekben alkalmazott MI-modellek az esetek 95%-ában nukleáris csapásig eszkalálták a konfliktust – ami arra utal, hogy a „Skynet” valós jelenség, csak még nem nyomták meg a nukleáris indítógombot.

Algoritmus alapú likvidálási program – Így cserkészi be áldozatait Izrael

AI alapú megfigyelés: Mi célzott reklámokat, a palesztinok rakétákat kapnak

(Guardian, Geopolitics Prime, Rybar, nyomán Szent Korona Rádió)