Folytatjuk a cikksorozatot, melyben az Izrael által használt azon mesterséges intelligenciát mutatjuk be, mely eldöntötte, hogy kit bombázzanak le a Gázai övezetben. A cikk első része ide kattintva elérhető. Jelen cikkben a célpontok meghatározásának metódusa kerül terítékre, melyből kiderül, hogy többször civileket bombáztak a Hamász tagjai helyett.

Első lépés: a célok meghatározása

“Ha egyszer automatikusan működik, a célpontok generálása megőrül”

Az izraeli hadseregben az „emberi célpont” kifejezés a múltban olyan magas rangú katonai ügynököt jelentett, akit a hadsereg nemzetközi jogi osztályának szabályai szerint magánlakásában is meg lehet ölni, még akkor is, ha a közelben civilek vannak. Hírszerzési források a +972-nek és a Local Callnak elmondták, hogy Izrael korábbi háborúi során, mivel ez egy „különösen brutális” módja volt annak, hogy valakit megöljenek – gyakran úgy, hogy a célpont mellett egy egész családot is megöltek -, az ilyen emberi célpontokat nagyon gondosan megjelölték, és csak magas rangú katonai parancsnokokat bombáztak otthonukban, hogy a nemzetközi jog szerinti arányosság elvét fenntartsák.

Október 7-e után azonban – amikor a Hamász vezette fegyveresek támadást indítottak dél-izraeli települések ellen (kitörtek a világ legnagyobb koncentrációs táborából), mintegy 1200 embert megölve és 240-et elrabolva – a hadsereg a források szerint drámaian más megközelítést alkalmazott. A „Vaskardok hadművelet” keretében a hadsereg úgy döntött, hogy a Hamász katonai szárnyának minden operatív tagját „emberi célpontnak” minősítik, tekintet nélkül rendfokozatukra vagy hadászati jelentőségükre. És ez mindent megváltoztatott.

Az új politika technikai problémát is jelentett az izraeli hírszerzés számára. A korábbi háborúkban ahhoz, hogy egy tiszt engedélyezze egyetlen “emberi célpont” meggyilkolását, egy bonyolult és hosszadalmas „gyanúsítási” folyamaton kellett keresztülmennie: keresztellenőrzéssel ellenőrizni a bizonyítékokat, hogy az illető valóban a Hamász katonai szárnyának magas rangú tagja-e, kideríteni, hol él, milyen elérhetőségei vannak, és végül valós időben tudni, mikor van otthon. Amikor a célpontok listája csak néhány tucat magas rangú ügynökből állt, a hírszerzés munkatársai egyénileg is el tudták látni a gyanúsításukkal és a felkutatásukkal járó munkát.

Miután azonban a lista több tízezer alacsonyabb rendfokozatú harcosra bővült, az izraeli hadsereg úgy gondolta, hogy az automatizált szoftverekre és a mesterséges intelligenciára kell támaszkodnia. A források tanúsága szerint az eredmény az lett, hogy az emberi személyzet szerepe a palesztinok katonaként való gyanúsításában háttérbe szorult, és helyette a mesterséges intelligencia végezte a munka nagy részét. A +972-nek és a Local Callnak nyilatkozó négy forrás szerint a Lavender – amelyet arra fejlesztettek ki, hogy emberi célpontokat listázzon le – mintegy 37 000 palesztint jelölt meg gyanúsított „Hamász-militánsokként”, többségében fiatalkorúakat, akiket meg kell ölni (az IDF szóvivője a +972-nek és a Local Callnak adott nyilatkozatában tagadta egy ilyen gyilkos lista létezését).

„Nem tudtuk, hogy kik a fiatalabb harcosok, mert Izrael nem követte őket rutinszerűen [a háború előtt]” – magyarázta B. főtiszt a +972-nek és a Local Callnak, megvilágítva a jelenlegi háborúra vonatkozó különleges célpont-gépezet kifejlesztésének okát. „Azt akarták, hogy automatikusan támadhassuk [a fiatalabbakat]. Ez a Szent Grál. Ha egyszer automatikusan működik, a célpontgenerálás megőrül”.

A források szerint a korábban csak segédeszközként használt Lavender gyilkos listák automatikus átvételére vonatkozó engedélyt a háború után körülbelül két héttel adták meg, miután a hírszerzés munkatársai „kézzel” ellenőrizték az AI rendszer által kiválasztott több száz célpontból álló véletlenszerű minta pontosságát. Amikor ez a minta megállapította, hogy a Lavender eredményei 90 százalékos pontosságot értek el az egyén Hamászhoz való tartozásának azonosításában, a hadsereg engedélyezte a rendszer átfogó használatát. Ettől a pillanattól kezdve a források szerint, ha a Lavender úgy döntött, hogy egy személy a Hamász militáns tagja, akkor lényegében arra kérték őket, hogy ezt parancsként kezeljék, anélkül, hogy függetlenül ellenőriznék, hogy a gép miért hozta ezt a döntést, vagy hogy megvizsgálnák a nyers hírszerzési adatokat, amelyeken alapul.

„Hajnali 5-kor [a légierő] jött és lebombázta az általunk megjelölt házakat” – mondta B.. „Több ezer embert öltünk meg. Nem egyenként mentünk végig rajtuk – mindent automatizált rendszerbe helyeztünk, és amint valamelyik [megjelölt személy] otthon volt, azonnal célponttá vált. Lebombáztuk őt és a házát”.

„Számomra nagyon meglepő volt, hogy arra kértek minket, hogy bombázzunk le egy házat, hogy megöljünk egy katonát, akinek a harcokban nagyon alacsony volt a jelentősége” – mondta egy forrás a mesterséges intelligenciával kapcsolatban, hogy állítólagos alacsony beosztásban lévő harcosokat jelöljenek meg. „Ezeket a célpontokat ‘szemét célpontoknak’ becéztem. Mégis etikusabbnak találtam őket, mint azokat a célpontokat, amelyeket csak az ‘elrettentés’ érdekében bombáztunk – magasépületeket, amelyeket kiürítettek és ledöntöttek, csak azért, hogy pusztítást okozzanak”

A háború korai szakaszában a korlátozások e lazításának halálos következményei megdöbbentőek voltak. A gázai palesztin egészségügyi minisztérium adatai szerint – amelyekre az izraeli hadsereg a háború kezdete óta szinte kizárólag támaszkodik – Izrael a háború első hat hetében, a november 24-én kötött egyhetes tűzszünetig mintegy 15 ezer palesztint ölt meg – az eddigi halálos áldozatok csaknem felét.

„Minél több információ és minél nagyobb a választék, annál jobb”

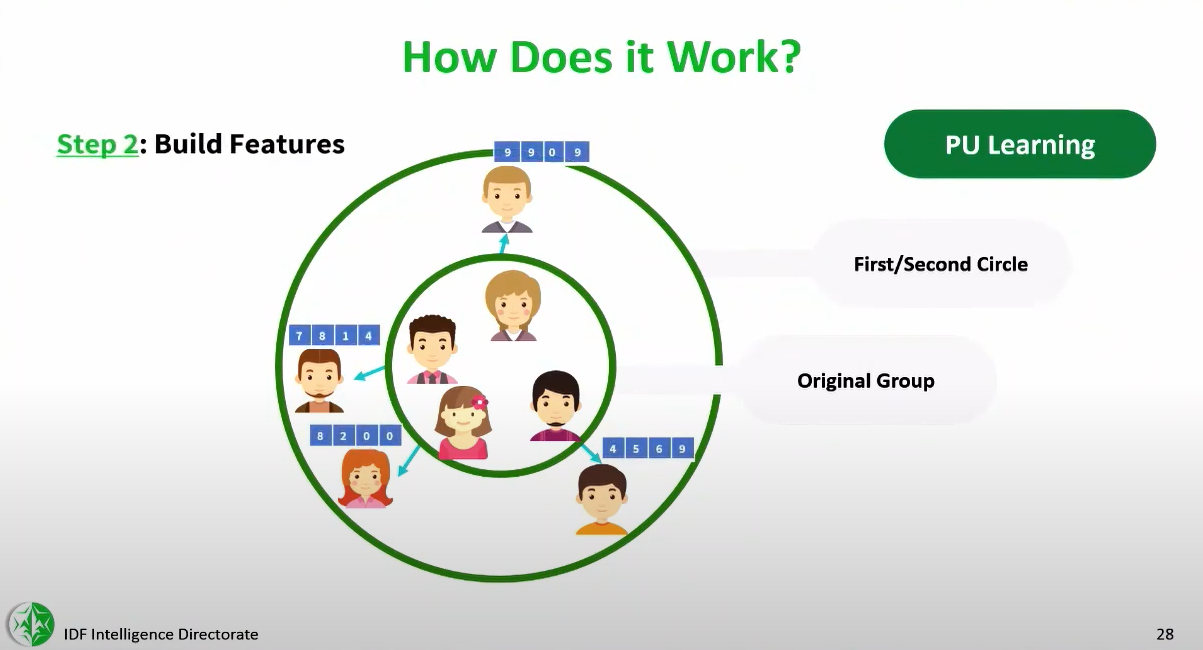

A Lavender szoftver elemzi a Gázai övezet 2,3 millió lakosáról a tömeges megfigyelési rendszer segítségével összegyűjtött adatokat, majd értékeli és rangsorolja annak valószínűségét, hogy az egyes személyek a Hamász vagy a PIJ katonai szárnyában mekkora valószínűséggel tevékenykedhetnek. Források szerint a gép szinte minden egyes gázai személyt 1-től 100-ig terjedő skálán értékel, kifejezve, hogy mennyire valószínű, hogy az illető militáns.

A Lavender megtanulta azonosítani a Hamász és a PIJ ismert tagjainak jellemzőit, akiknek az információit betanítási adatként táplálták a gépbe, majd ugyanezeket a tulajdonságokat megtanulta megtalálni az általános lakosság körében – magyarázták a források. Egy olyan személy, akiről kiderül, hogy több különböző terhelő tulajdonsággal rendelkezik, magas minősítést ér el, és így automatikusan potenciális célpontjává válik a merényleteknek.

Az első cikk elején említett „Az ember-gép csapat” című könyvben a 8200-as egység jelenlegi parancsnoka egy ilyen rendszer mellett érvel, anélkül, hogy név szerint említené Lavendert. (Maga a parancsnok sincs megnevezve, de a 8200-as egység öt forrása megerősítette, hogy a parancsnok a szerző, amint arról a Haaretz is beszámolt). Az emberi személyzetet „szűk keresztmetszetként” jellemezve, amely korlátozza a hadsereg kapacitását egy katonai művelet során, azon lamentált, hogy: „Mi [emberek] nem tudunk ennyi információt feldolgozni. Nem számít, hogy hány embert bízunk meg a háború során a célpontok létrehozásával – még mindig nem tudunk elég célpontot létrehozni egy nap alatt”.

A megoldás erre a problémára szerinte a mesterséges intelligencia. A könyv rövid útmutatót kínál egy, a Lavenderhez hasonló, mesterséges intelligencián és gépi tanulási algoritmusokon alapuló „célgép” építéséhez. Ebben az útmutatóban számos példát találunk a „több száz és ezer” olyan jellemzőre, amelyek növelhetik egy személy besorolását, mint például az, hogy egy ismert militánssal közös Whatsapp-csoportban van, néhány havonta cseréli a mobiltelefonját, és gyakran változtatja a lakcímét.

„Minél több az információ és minél változatosabb, annál jobb” – írja a parancsnok. „Vizuális információk, mobiltelefonos információk, közösségi média kapcsolatok, harctéri információk, telefonos kapcsolatok, fényképek”. Bár eleinte az emberek választják ki ezeket a jellemzőket, folytatja a parancsnok, idővel a gép magától is azonosítani fogja a jellemzőket. Ez szerinte lehetővé teheti a hadseregek számára, hogy „több tízezer célpontot” hozzanak létre, miközben a tényleges döntés, hogy megtámadják-e őket vagy sem, emberi döntés marad.

Nem ez a könyv az egyetlen, ahol egy magas rangú izraeli parancsnok utalt a Lavenderhez hasonló emberi célpontokat kereső gépek létezésére. A +972 és a Local Call megszerezte a felvételeket arról a zártkörű előadásról, amelyet a Unit 8200 titkos adattudományi és mesterséges intelligencia központjának parancsnoka, „Yoav ezredes” tartott a Tel Aviv-i Egyetem mesterséges intelligencia hetén 2023-ban, és amelyről annak idején az izraeli média is beszámolt.

Az előadásban a parancsnok beszél az izraeli hadsereg által használt új, kifinomult célkereső gépről, amely a „veszélyes embereket” az alapján ismeri fel, hogy hasonlítanak az ismert militánsok meglévő listáihoz, amelyek alapján kiképezték őket. „A rendszer segítségével sikerült azonosítanunk a Hamász rakétaosztagok parancsnokait” – mondta »Yoav ezredes« az előadásban, utalva Izrael 2021. májusi gázai katonai műveletére, amikor először használták a gépet.

A +972 és a Local Call által is megszerzett előadás prezentációs diái illusztrációkat tartalmaznak arról, hogyan működik a gép: adatokat kap a meglévő Hamász-ügynökökről, megtanulja észrevenni a jellemzőiket, majd aszerint értékeli a többi palesztint, hogy mennyire hasonlítanak az előzetesen felöltött jellemzőkre.

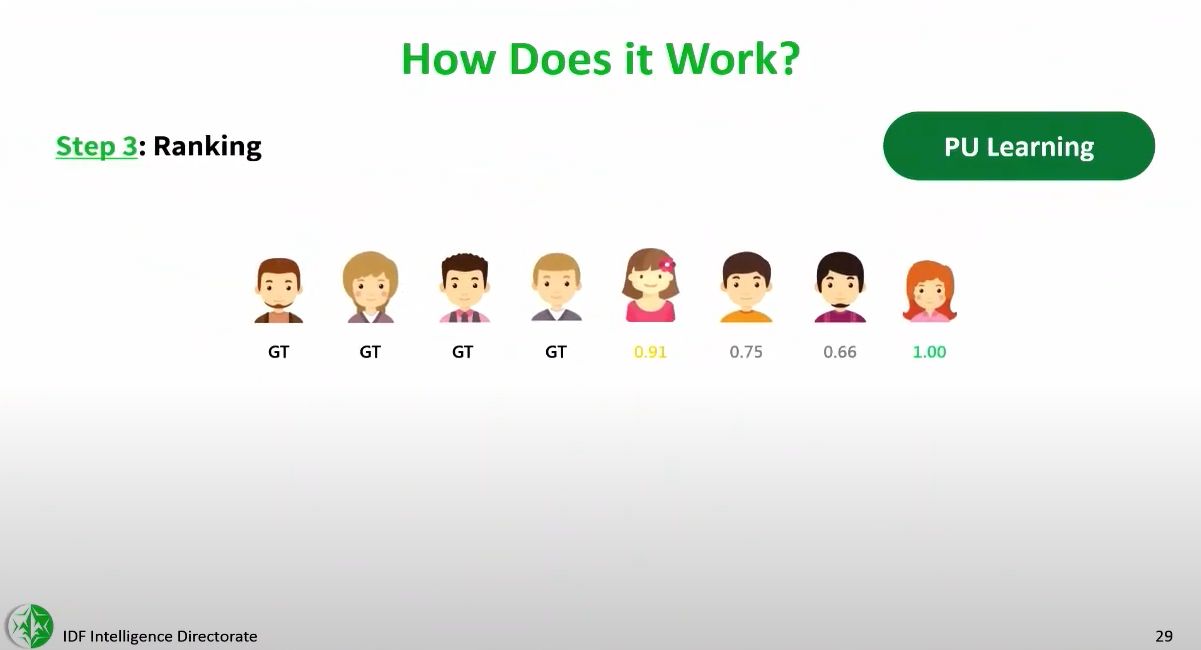

„Mi rangsoroljuk az eredményeket és határozzuk meg a küszöbértéket [amelynél egy célpontot megtámadunk]” – mondta „Yoav ezredes” az előadásban, hangsúlyozva, hogy „végül hús-vér emberek hozzák meg a döntéseket”. A védelmi területen etikai szempontból nagy hangsúlyt fektetünk erre. Ezek az eszközök arra szolgálnak, hogy segítsenek [a hírszerzőknek] lebontani a korlátaikat”.

A gyakorlatban azonban a Lavendert az elmúlt hónapokban használó források szerint az emberi ügynöki tevékenységet és pontosságot felváltotta a tömeges célpontok létrehozásának és a mortalitás fokozásának feladata.

Nem volt „hibamentes” politika

B., egy magas rangú tiszt, aki a Lavendert használta, a +972-nek és a Local Callnak elismételte, hogy a jelenlegi háborúban a tiszteknek nem kellett önállóan felülvizsgálniuk az AI rendszer értékeléseit, hogy időt takarítsanak meg, és lehetővé tegyék az emberi célpontok akadályok nélküli tömeges létrehozását.

„Minden statisztikai volt, minden rendben volt – nagyon száraz volt” – mondta B.. Megjegyezte, hogy a felügyelet hiányát annak ellenére engedélyezték, hogy a belső ellenőrzések szerint Lavender számításait csak az esetek 90 százalékában tartották pontosnak; más szóval, előre tudták, hogy a merényletre kijelölt emberi célpontok 10 százaléka egyáltalán nem a Hamász katonai szárnyának tagja volt.

A források például kifejtették, hogy a Lavender-gép néha tévesen megjelölt olyan személyeket, akiknek a kommunikációs mintája hasonlított az ismert Hamász- vagy PIJ-ügynökökéhez – beleértve a rendőrségi és polgári védelmi dolgozókat, a fegyveresek rokonait, olyan lakosokat, akiknek a neve és beceneve véletlenül megegyezett egy harcoséval, és olyan gázaiakat, akik olyan eszközt használtak, amely egykor a Hamász egyik tagjához tartozott.

„Milyen közel kell állnia egy személynek a Hamászhoz ahhoz, hogy egy mesterséges intelligenciával működő gép [úgy tekintse, hogy] kapcsolatban áll a szervezettel?” – tette fel a kérdést egy forrás, aki kritikusan nyilatkozott Lavender pontatlanságáról. „Ez egy homályos határ. Az a személy, aki nem kap fizetést a Hamásztól, de segít nekik mindenféle dolgokban, Hamász-tagnak számít? Valaki, aki a múltban a Hamász tagja volt, de ma már nem az, hamászosnak számít? Mindegyik ilyen jellemző – olyan jellemzők, amelyeket egy gép gyanúsnak jelölne meg – pontatlan”.

Hasonló problémák merülnek fel a célkereső gépek azon képességével kapcsolatban, hogy felmérjék a merényletre kijelölt személy által használt telefont. „Háborúban a palesztinok állandóan telefonokat cserélnek” – mondta a forrás. „Az emberek elveszítik a kapcsolatot a családjukkal, odaadják a telefonjukat egy barátjuknak vagy feleségüknek, esetleg elveszítik. Nem lehet 100 százalékosan megbízni abban az automatikus mechanizmusban, amely meghatározza, hogy melyik telefonszám kihez tartozik”.”

A források szerint a hadsereg tudta, hogy a minimális emberi felügyelet nem fogja megtalálni ezeket a hibákat. „Nem volt ‘zéró hiba’ politika. A hibákat statisztikailag kezelték” – mondta egy forrás, aki Lavendert használt. „A terjedelem és a nagyságrend miatt a protokoll az volt, hogy még ha nem is tudod biztosan, hogy a gépnek igaza van, tudod, hogy statisztikailag rendben van. Tehát belevágsz.”

„Ez már bizonyított” – mondta B., a rangidős forrás. „Van valami a statisztikai megközelítésben, ami egy bizonyos normához és mércéhez köt. Logikátlanul sok [robbantás] történt ebben a műveletben. Emlékeim szerint ilyenre még nem volt példa. És sokkal jobban bízom egy statisztika mechanizmusában, mint egy olyan katonában, aki két napja elvesztette egy barátját. Mindenki ott, beleértve engem is, elvesztett embereket október 7-én. A gépezet hidegvérrel végezte a dolgát. És ez megkönnyítette a helyzetet.”

Egy másik hírszerzési forrás, aki megvédte a palesztin gyanúsítottak Lavender által generált gyilkos listáira való kerülését, azzal érvelt, hogy csak akkor érdemes egy hírszerző tiszt idejét az információ ellenőrzésére fordítani, ha a célpont a Hamász egyik magas rangú parancsnoka. „De ha egy fiatalabb militánsról van szó, nem akarunk embert és időt invesztálni ebbe” – mondta. „A háborúban nincs idő minden célpontot meggyanúsítani. Ezért hajlandó vagy vállalni a mesterséges intelligencia használatának hibahatárát, kockáztatva a járulékos károkat és a civilek halálát, valamint a tévedésből történő támadás kockázatát, és együtt kell élned vele”.

B. szerint ennek az automatizálásnak az oka az volt, hogy folyamatosan újabb célpontokat akartak létrehozni a merényletekhez. „Egy olyan napon, amikor nem voltak célpontok [amelyek jellemzőinek minősítése elegendő volt a csapás engedélyezéséhez], alacsonyabb küszöbértékkel támadtunk. Folyamatosan nyomást gyakoroltak ránk: ‘Hozzatok nekünk több célpontot’. Tényleg ordítottak velünk. Nagyon gyorsan végeztünk [a célpontjaink megölésével]”.

Elmagyarázta, hogy a Lavender minősítési küszöbének csökkentésével több embert jelölne meg a csapások célpontjaként. „A rendszer a csúcspontján 37 000 embert sikerült potenciális emberi célpontként generálnia” – mondta B. „De a számok folyamatosan változtak, mert attól függ, hogy hová helyezzük a mércét, hogy ki számít Hamász tagnak”. Voltak időszakok, amikor a hamászosokat tágabban definiálták, aztán a gép elkezdett nekünk mindenféle polgári védelmi személyzetet, rendőrtiszteket behozni, akikre kár lenne bombákat pazarolni. Ők segítik a Hamász-kormányt, de nem igazán veszélyeztetik a katonákat”.

Egy forrás, aki a Lavendert kiképző katonai adattudományi csoporttal dolgozott, azt mondta, hogy a Hamász vezette Belbiztonsági Minisztérium alkalmazottaitól gyűjtött adatokat – akiket nem tart militánsoknak – szintén betáplálták a gépbe. „Zavart, hogy amikor Lavendert kiképezték, a „Hamász-ügynök” kifejezést lazán használták, és olyan embereket is bevontak a kiképzési adathalmazba, akik a polgári védelem munkatársai voltak” – mondta.

A forrás hozzátette, hogy még ha valaki úgy is gondolja, hogy ezek az emberek megérdemlik a gyilkosságot, a rendszer kommunikációs profiljuk alapján történő kiképzése miatt a Lavender nagyobb valószínűséggel választ ki civileket, amikor az algoritmusait az általános lakosságra alkalmazzák. „Mivel ez egy automatikus rendszer, amelyet nem ember kezel kézzel, ennek a döntésnek drámai a jelentősége: azt jelenti, hogy sok civil kommunikációs profillal rendelkező embert von be potenciális célpontként”.

„Csak azt ellenőriztük, hogy a célpont férfi volt-e”

Az izraeli hadsereg határozottan elutasítja ezeket az állításokat. Az IDF szóvivője a +972-nek és a Local Callnak adott nyilatkozatában tagadta, hogy mesterséges intelligenciát használnának a célpontok gyanúsítására, mondván, hogy ezek csupán „segédeszközök, amelyek segítik a tiszteket a gyanúsítás folyamatában”. A közlemény így folytatta: „Minden esetben szükség van egy [hírszerzési] elemző független vizsgálatára, amely ellenőrzi, hogy az azonosított célpontok legitim támadási célpontok-e, az IDF irányelveiben és a nemzetközi jogban meghatározott feltételekkel összhangban”.

A források szerint azonban a Lavender által megjelölt feltételezett „fiatalabb” harcosok házainak bombázása előtt az egyetlen emberi felügyeleti protokoll egyetlen ellenőrzés elvégzése volt: annak biztosítása, hogy az AI által kiválasztott célpont férfi legyen, ne pedig nő. A hadseregben azt feltételezték, hogy ha a célpont nő, akkor a gép valószínűleg hibázott, mivel a Hamász és a PIJ katonai szárnyainak soraiban nincsenek nők.

„Egy embernek mindössze néhány másodpercig kellett [ellenőriznie a célpontot]” – mondta B., és elmagyarázta, hogy ez lett a protokoll, miután rájöttek, hogy a Lavender rendszer az esetek többségében »jól csinálta«. „Eleinte azért végeztünk ellenőrzéseket, hogy a gép ne zavarodjon össze. De egy bizonyos ponton már az automatikus rendszerre hagyatkoztunk, és csak azt ellenőriztük, hogy [a célpont] férfi-e – ez elég volt. Nem tart sokáig megállapítani, hogy valakinek férfi vagy női hangja van-e”.

A férfi/női ellenőrzés elvégzéséhez B. azt állította, hogy a jelenlegi háborúban „minden egyes célpontra 20 másodpercet fordítanék ebben a szakaszban, és naponta több tucatot csinálnék meg belőlük. Emberként nulla hozzáadott értékem volt, azon kívül, hogy egy bélyegző voltam. Ezzel rengeteg időt spóroltam meg. Ha [a palesztin] felbukkant az automatizált mechanizmusban, és ellenőriztem, hogy férfi, akkor engedélyt kaptam a bombázásra, a járulékos károk vizsgálatának függvényében”.

A források szerint ez a gyakorlatban azt jelentette, hogy a Lavender által tévesen megjelölt civil férfiak esetében nem volt olyan felügyeleti mechanizmus, amely a hibát felismerte volna. B. szerint gyakori hiba volt, „ha a [Hamász] célpontja a fiának, az idősebb testvérének vagy csak egy véletlenszerű embernek adta [a telefonját].Ezt az embert a házában bombázták le a családjával együtt.Ez gyakran megtörtént.

A legtöbb ilyen hibát a Lavender okozta” – mondta B.

Folytatjuk…

A két sátáni összefog: MI segítségével végzi a népirtást Izrael (I. rész)

(+972, Local Call nyomán Szent Korona Rádió)