Forradalmi fejlesztéseket ígértek, de egyelőre hibát hibára halmoznak az egészségügyi AI-eszközök. Nem kis balesetek történtek. Volt, hogy a beteg orrából agy-gerincvelői folyadék kezdett folyni, egy másik esetben pedig a sebész tévedésből átszúrta a beteg koponyaalapját – az AI hibái miatt. A Qubit összegezte, mit lehet tudni jelenleg az egészségügyi AI-eszközökről.

Kövesd Telegram csatornánkat!

Folyamatosan frissítve a háborús hírekkel és a nagyvilág történéseivel

Nem nagyon telik el hónap úgy, hogy ne történne valamilyen jelentős áttörés a mesterséges intelligencia (AI) területén: a legújabb AI-modellek az elmúlt hetekben már komplex matematikai problémákat oldanak meg és jól programoznak, miközben specializált AI-algoritmusok egyre hatékonyabbak a szervezetünkben zajló molekuláris kölcsönhatások modellezésében, és ezáltal új gyógyszerek és terápiák tervezésében.

Elvben pont az egészségügy az egyik olyan terület, ahol a mesterséges intelligencia alkalmazása a legtöbb haszonnal és fejlesztéssel járhat. De ha körbenézünk a friss kutatások és tényfeltárások között, ehelyett egyelőre az a kép rajzolódik ki, hogy az AI-jal kiegészített orvostechnikai eszközök, AI-alapú egészségügyi tanácsadást ígérő alkalmazások és a százmilliók által használt chatbotok sokszor a vártnál rosszabbul teljesítenek, vagy egyenesen komoly kockázatokat rejtenek.

Agyvérzést és véletlen koponyafúrást okozhatott az AI-jal felruházott sebészeti segédeszköz

A Reuters február elején megjelent tényfeltáró cikkében az AI-jal felruházott orvostechnikai eszközök megbízhatóságának járt utána, és amit talált, az finoman szólva sem megnyugtató. Ott van például annak a sebészek munkáját segítő orvostechnikai eszköznek a története, amelynek szoftverét 2021-ben egy gépi tanulási algoritmussal turbózták föl – amit akkor az amerikai egészségügyi óriáscég, a Johnson & Johnson nagy előrelépésként igyekezett eladni. A TruDi Navigációs Rendszernek nevezett berendezés a műtét során egy kijelzőn több nézetből mutatja meg a sebésznek az általa használt eszköz helyzetét a páciens testén belül, ezzel segítve a krónikus arcüreggyulladás kezelését célzó műtéteket.

Ekkor a berendezés már három éve elérhető volt a piacon, ami alatt az amerikai Élelmiszer- és Gyógyszerfelügyeleti Hatóság (FDA) hét, nem megerősített bejelentést kapott a meghibásodásáról, valamint egy további esetről, amelynek során egy páciens megsérült. Mióta viszont a TruDi Navigációs Rendszert gépi tanulási algoritmussal ruházták fel, legalább száz meghibásodásról és nemkívánatos eseményről, valamint 10 páciens sérüléséről érkezett bejelentés a hatóságnak. Ezek többsége a vádak szerint abból fakadt, hogy

a rendszer félreinformálhatta a sebészt a sebészeti eszközök pontos helyzetéről, miközben ők beavatkozásokat végeztek a betegeken.

Egy esetben a beteg orrából a jelentés szerint agy-gerincvelői folyadék kezdett folyni, egy másik esetben pedig a sebész tévedésből átszúrta a beteg koponyaalapját.

A Reuters szerint az FDA jelentései nem elég részletesek ahhoz, hogy kiderüljön, mekkora szerepe volt ezekben a műtéti hibákban a mesterséges intelligenciának. De két páciens, akiknél elmondásuk szerint a beavatkozás következtében agyvérzés alakult ki, pert indítottak, azt állítva, hogy sérüléseikhez hozzájárult a TruDi AI-rendszere.

„A termék biztonságosabb volt, mielőtt a szoftverébe beépítették volna a mesterséges intelligenciát”

– állítja az egyik kereset.

A TruDi orvostechnikai eszközt gyártó Acclarent cég jelenlegi tulajdonosa, az Integra LifeSciences azt nyilatkozta, hogy az FDA-jelentések „legfeljebb annyit mutatnak, hogy a TruDi rendszert olyan műtétek során használták, amelyek során nemkívánatos esemény történt”, és „nincs hiteles bizonyíték arra, hogy bármilyen ok-okozati összefüggés lenne a TruDi Navigációs Rendszer, az AI-technológia és a vélelmezett sérülések között”.

Nem a TruDi az egyetlen AI-jal kiegészített eszköz, amivel szemben az utóbbi időben aggályok merültek fel. Az FDA több tucat más eszközről kapott aggasztó jelentéseket: egy szívmonitorról, amely állítólag nem vette észre a rendellenes szívveréseket, vagy éppen

egy olyan ultrahangkészülékről, amely tévesen azonosította a magzati testrészeket

– igaz, ezek az esetek nem vezettek sérülésekhez vagy károsodásokhoz. Eközben amerikai kutatók tavaly azt találták, hogy 60, AI-jal felruházott és a hatóság által jóváhagyott orvostechnikai eszközhöz 182 visszahívás társult. Ráadásul ezeknek a visszahívásoknak 43 százaléka kevesebb mint egy évvel az FDA-jóváhagyás megszerzése után történt.

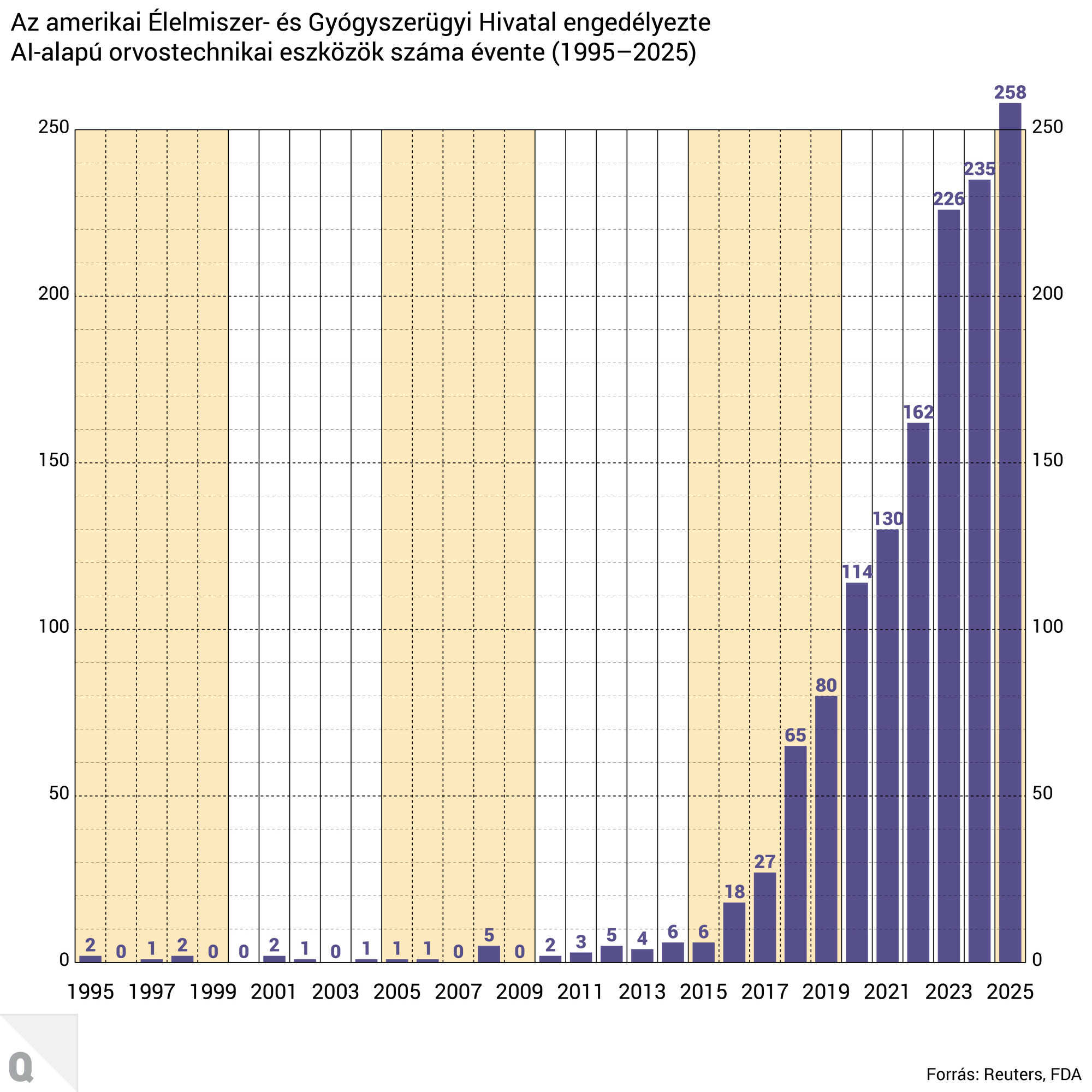

Az FDA eddig 1357 darab, AI-jal ellátott orvostechnikai eszközt hagyott jóvá, amelyek száma 2022 óta megduplázódott. Öt, korábban vagy jelenleg is a hatóságnál dolgozó kutató szerint az AI-láz így komoly kihívás elé állítja az FDA-t. Ezt tovább nehezíti, hogy tavaly az Elon Musk által fémjelzett kormányzati hatékonysági kezdeményezés (DOGE) részben felszámolta az FDA AI-csapatát, és az ott dolgozó 40 kutatóból 15-öt ki is rúgtak, vagy ők maguk döntöttek távozás mellett. Az amerikai egészségügyi minisztérium (HHS), amely alá az FDA tartozik, látszólag tisztában van a problémával: a hírügynökségnek azt nyilatkozták, hogy dolgoznak a kapacitásbővítésen.

De nem feltétlenül csak az számít, hogy hányan dolgoznak az orvosi AI-eszközök szabályozásán a hatóságnál. „Az FDA hagyományos megközelítése az orvostechnikai eszközök szabályozásához nem elegendő annak garantálására, hogy az AI-alapú technológiák biztonságosak és hatásosak” – mondta Alexander Everhart, a Washington Egyetem orvosi karának szakértője a Reutersnek. „A gyártókra hagyatkozunk, hogy megfelelő munkát végezzenek a termék piacra dobásakor. Nem tudom, hogy az FDA ellenőrzése érdemi biztosítékot jelent-e” – mondta.

Ellepik az alkalmazásboltokat az egészségügyi tanácsokat ígérő AI-appok

Miközben az orvostechnikai eszközöket hatóság ellenőrzi, a nem diagnosztikai célú, AI-alapú egészségügyi tanácsokat ígérő alkalmazások feletti kontroll leginkább az alkalmazásboltokat üzemeltető Apple-re és Google-re hárul. A Reuters egészségügyi AI-appokat és chatbotokat vizsgáló, február elején megjelent cikke arra utal, hogy a techóriások szűrőin a gyakorlatban több megbízhatatlannak tűnő alkalmazás is átcsúszik.

Ilyen volt például a személyes egészségügyi asszisztensként hirdetett, „Eureka Health: AI Doctor” nevű alkalmazás is. Bár leírásában fel volt tüntetve, hogy az appban szereplő információk „csak tájékoztató jellegűek”, nem felelt meg az Apple szabályzatának, miszerint az orvosi célú alkalmazások fejlesztőinek fel kell tárniuk, hogy milyen adatok és módszerek alapján jutottak a felhasználók egészségi állapotával összefüggő következtetésekre. A fejlesztői szabályok megsértése viszont csak akkor bukott ki, amikor a Reuters felhívta az Apple figyelmét az alkalmazásra, amit aztán a cég el is távolított az App Store-ból.

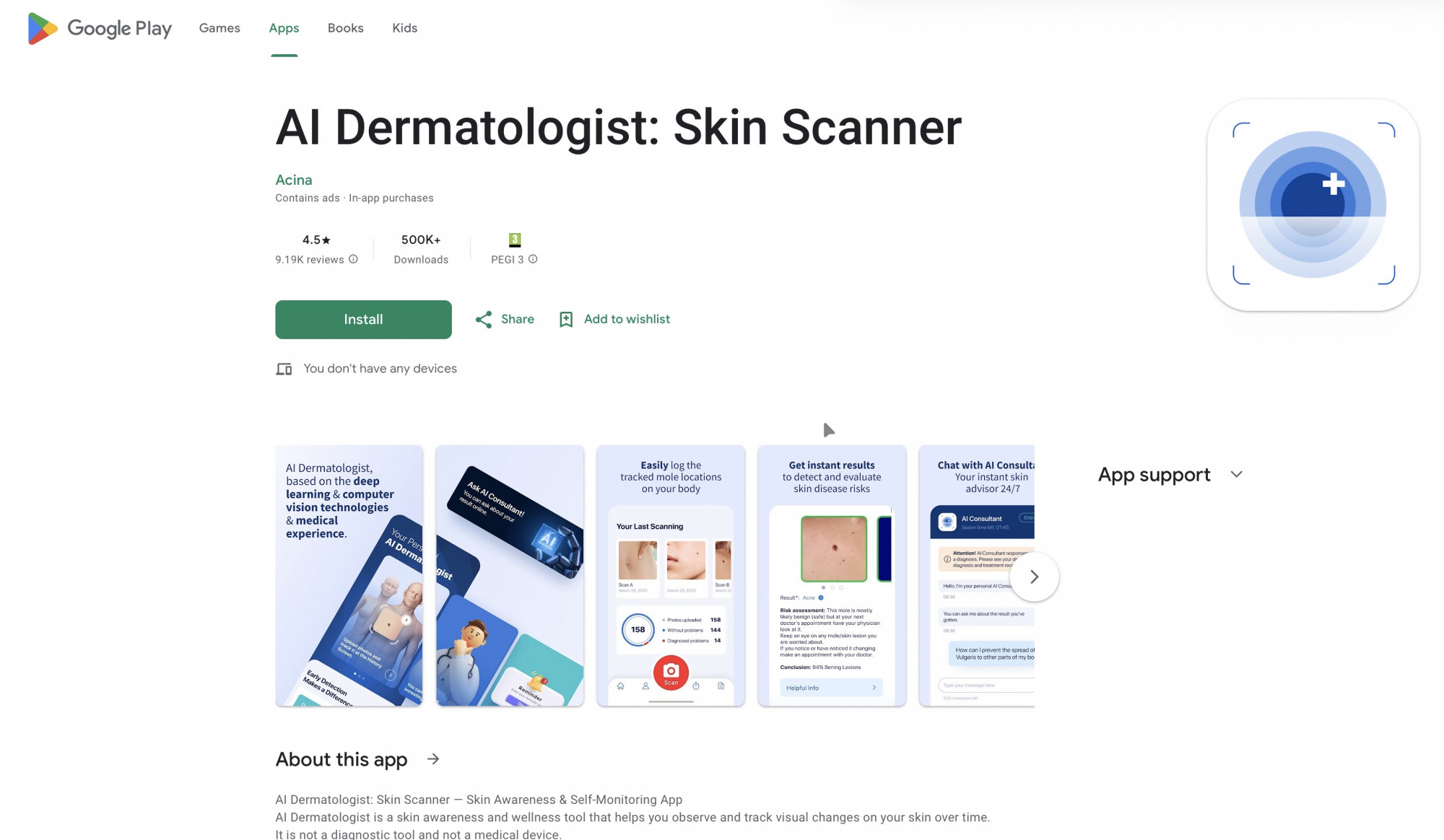

Egy másik, anyajegyek és bőrelváltozások által jelentett bőrrákkockázat felmérésre hivatott, „AI Dermatologist: Skin Scanner” nevű alkalmazásnál a felhasználói értékelések vezették a hírügynökség újságíróit arra, hogy az app a fejlesztői ígéreteivel szemben rengetegszer téved. Az alkalmazást fejlesztő Acina szerint a neurális hálójuk több mint 97 százalékos pontosságú, de ez a több száz egycsillagos értékelés és felhasználói kritika alapján erősen vitathatónak tűnik.

Az Acina azt nyilatkozta, hogy nem orvosi diagnózis felállítása a céljuk, hanem az, hogy egyfajta kezdeti értékelést biztosítsanak a felhasználóknak, ami bőrgyógyászati szakirodalmon és gondosan válogatott adathalmazokon alapul. Miután a Reuters ennek az alkalmazásnak is utánakérdezett az Apple-nél és a Google-nél, az appot eltávolították az App Store-ból és a Google Play Store-ból (azóta viszont, miután fejlesztői változtattak leírásán, a Play Store-ban újra elérhető).

Egy, a Qubit által végzett keresés legalább egy tucat hasonló appot tárt fel a két legnagyobb alkalmazásboltban, amik pontossága ugyanúgy kérdéseket vethet fel. „Ezt nagyon aggasztónak tartom, mert a bőrelváltozások megbízható azonosítása rendkívül nehéz” – mondta a hírügynökségnek Rachel Draelos orvos és egészségügyi AI-tanácsadó. Mivel több ezer bőrbetegség létezik, szinte kizártnak tartja, hogy az alkalmazásokba épített adatbázisok az összeset le tudják fedni.

Pontatlanok a chatbotok, de ez nem (csak) azok hibája

De mi a helyzet a legnépszerűbb chatbotokkal, amiket több száz millióan használnak világszerte, sokszor éppen saját egészségükkel kapcsolatos kérdések megválaszolására? Egy múlt héten közölt kutatás szerint, amiről a New York Times számolt be, a vizsgált chatbotmodellek nem bizonyultak jobbnak egy Google-keresésnél abban, hogy a felhasználókat a helyes diagnózis felé tereljék.

A meghökkentő megállapítást árnyalja, hogy a vizsgálatban 2024 tavaszán kiadott AI-modelleket teszteltek, szimulált egészségügyi forgatókönyvekkel. Andrew Bean, az Oxfordi Egyetem ember és mesterséges intelligencia közötti együttműködéssel foglalkozó AI-kutatójának és kollégáinak a Nature Medicine-ben megjelent kutatása ugyanakkor az első randomizált vizsgálat, amely a chatbotok egészségügyi válaszait vizsgálta, és rámutat olyan problémákra is, amiket az AI-modellek rohamos fejlődése nem old meg egykönnyen.

A vizsgálat 1300 résztvevőjével 10, előre megírt egészségügyi forgatókönyvet teszteltek. Háromnegyedüket véletlenszerűen a ChatGPT GPT-4o, a Meta Llama 3, és a Cohere Command R+ nagy nyelvi modelljeihez irányították, a kontrollcsoportot alkotó egynegyedük pedig a válaszadáshoz bármilyen forrást felhasználhatott, például internetes keresést vagy saját tudását. Amikor a kutatók az AI-modelleket önállóan tesztelték, a teljes kitalált forgatókönyv bemásolásával, azok pontosan oldották meg az eseteket, korrekt diagnózist adva az esetek 95 százalékában. Amikor viszont a felhasználók kérdezték a chatbotokat,

a helyes diagnózist már csak az esetek 35 százalékában találták el, ami nem volt jobb, mint a netes keresésekkel született eredmény.

Az OpenAI szóvivője a New York Timesnak azt állította, hogy a jelenlegi ChatGPT-modellek szignifikánsan jobbak az egészségügyi kérdések megválaszolásában a kutatásban tesztelt modelleknél. Emellett belső adatokra hivatkozva azt mondta, hogy az új ChatGPT-modellek ritkábban követnek el olyan tipikus hibákat, mint a hallucináció, vagy a sürgős helyzetekben előforduló tévedések. A felhasználók és szakértők körében először csalódást keltő GPT–5-tel, amelynek azóta két újabb verziója is megjelent, az OpenAI éppen a hallucinációk csökkentésében ért el jelentősebb javulást.

A lap szerint a kutatás még korlátaival együtt is feltárja, hogy miként csúszhatnak félre a chatbotokkal folytatott egészségügyi témájú beszélgetések. A chatbotok hibái ugyanis az esetek felében felhasználói hibákból származtak: a résztvevők nem adtak meg elegendő információt a modelleknek, vagy pont a legrelevánsabb tüneteket felejtették ki, és így az AI-modelleknek hiányos információkból kellett diagnózist felállítaniuk. Az nem újdonság, hogy a legjobb válaszokhoz jól kell tudni promptolni a chatbotokat. Bean szerint ugyanakkor az AI-cégeknek nem a felhasználókra kellene hárítaniuk annak felelősségét, hogy a lehető legpontosabb kérdésekkel álljanak elő, hanem a modelleknek az orvosokhoz hasonlóan – akiket kifejezetten megtanítanak a releváns tünetek felismerése – további, tisztázó kérdéseket kellene feltenniük.

„Öt éved van hátra” – közölte a ChatGPT

Amikor a chatbotokkal súlyos egészségügyi problémákról beszélnek felhasználók, nem csak az általuk legenerált információk pontossága számít. A Reutersnek nemrég Cem Aksoy, egy ankarai kórház rezidense arról mesélt, hogy egy 18 éves páciense és családja pánikba esett, miután a ChatGPT a páciens bal lábán kialakult tumor miatt azt válaszolta: lehetséges, hogy már csak 5 évig marad életben.

A chatbot tévedett: a tumort műtéti úton sikeresen eltávolították, és a páciens lényegében meggyógyult. De a beteg néhány héttel később sírva hívta fel orvosát, azzal, hogy a ChatGPT szerint a daganata áttétet képezhetett és átterjedhetett a tüdejére, mivel az utóbbi időben köhögni kezdett. Aztán az orvosi vizsgálatnak köszönhetően kiderült, hogy a tüdeje rendben van, és csak azért köhög, mert nemrég dohányozni kezdett.

„Ha valaki zaklatott, és nem kap iránymutatást, [egy AI-chatbot] be tudja rántani őt egy kontextus nélküli információdzsungelbe”

– mondta Aksoy. A hírügynökség megkeresésére az OpenAI azt reagálta, hogy a legújabb modellek sokkal jobban kezelik már az egészségügyi kérdéseket, de a ChatGPT nem az egészségügyi szakember tanácsának helyettesítésére szolgál.

Ezek az esetek – legyen szó akár az AI-jal felruházott sebészeti segédeszközről, a pontatlan AI-diagnosztikát kínáló appokról, vagy a felhasználókat megijesztő chatbotokról – nemcsak a rohamosan fejlődő technológia még meglévő hiányosságaira vagy szabályozási problémákra hívják fel a figyelmet, hanem az AI-rendszerek és az emberek közti kommunikáció során keletkező félreértésekre és a felhasználói tudatosság hiányából adódó kihívásokra is, amiket nehezebb lesz teljesen kiküszöbölni.

Transzhumanizmus, tenyésznők és génmódosítás – Egyre betegebb dolgok derülnek ki Epsteinről

(Qubit nyomán Szent Korona Rádió)